Από την ELIZA στο ChatGPT: Μια Σύντομη Ιστορία

Η ιδέα ενός «ψυχοθεραπευτή-μηχανής» δεν είναι νέα. Το 1966, ο Joseph Weizenbaum στο MIT δημιούργησε την ELIZA, ένα πρωτόγονο chatbot που μιμούνταν έναν ψυχοθεραπευτή Rogerian — αντανακλώντας τις λέξεις του χρήστη σε ερωτήσεις. Αν και τεχνολογικά απλοϊκή, η ELIZA εξέπληξε τον κόσμο: πολλοί χρήστες πίστεψαν ότι μιλούσαν με πραγματικό άνθρωπο.

Σήμερα, με τα Large Language Models (LLMs) όπως το ChatGPT, Claude, και το Gemini, βρισκόμαστε σε μια εντελώς διαφορετική εποχή. Μια έρευνα του Sentio University (αρχές 2025) βρήκε ότι 48.7% των ενηλίκων στις ΗΠΑ με ψυχικά θέματα που χρησιμοποιούν LLMs τα απευθύνθηκαν για υποστήριξη σε άγχος, κατάθλιψη, μοναξιά ή σχετικά ζητήματα.

Οι Τεχνολογίες Πίσω Από το AI Mental Health

Machine Learning

Αναγνωρίζει patterns σε τεράστια datasets — ανακαλύπτει συσχετίσεις που ανθρώπινοι ερευνητές θα χρειάζονταν χρόνια να εντοπίσουν.

NLP (Επεξεργασία Φυσικής Γλώσσας)

Αναλύει ομιλία, κείμενο & τόνο φωνής. Ανιχνεύει σημάδια ψυχικής δυσφορίας μέσα από γλωσσικά μοτίβα και πρότυπα αίσθησης.

Computer Vision

Αναλύει εκφράσεις προσώπου, γλώσσα σώματος & μικρο-εκφράσεις για αξιολόγηση συναισθηματικών καταστάσεων σε πραγματικό χρόνο.

LLMs & Generative AI

Παρέχουν θεραπευτική υποστήριξη 24/7, χαμηλότερο κόστος, αυξημένη προσβασιμότητα — αλλά με κινδύνους hallucinations & ψήτσα αιτιολογίας.

AI Θεραπευτές: Ποιοι Είναι;

Woebot Stanford

Chatbot βασισμένο σε CBT (Γνωσιακή-Συμπεριφορική Θεραπεία). Παρακολουθεί τη διάθεση μέσω σύντομων ημερήσιων συνομιλιών. Σε τυχαιοποιημένη κλινική δοκιμή (Fitzpatrick et al., 2017) μείωσε σημαντικά τα καταθλιπτικά συμπτώματα σε νέους ενήλικες μέσα σε 2 εβδομάδες.

Ellie USC

Εικονικός θεραπευτής του University of Southern California. Μέσω webcam & μικροφώνου επεξεργάζεται εκφράσεις προσώπου και τόνο φωνής σε πραγματικό χρόνο.

Cogito Voice AI

Αναλύει αλλαγές στην ένταση (pitch) και δυναμική φωνής (loudness) για ανίχνευση συμπτωμάτων κατάθλιψης ή άγχους κατά τη διάρκεια κλήσεων.

XAIA Cedars-Sinai

Πρωτοποριακό πρόγραμμα (Ιαν. 2024) που συνδυάζει εμβυθιστική εικονική πραγματικότητα με generative AI για ψυχική υγεία — ένας «θεραπευτής» που μοιάζει με άνθρωπο μέσα σε VR.

Oura Ring Wearable

Φορητή τεχνολογία που σαρώνει καρδιακό ρυθμό και ρουτίνα ύπνου σε πραγματικό χρόνο, δίνοντας εξατομικευμένες προτάσεις ψυχικής υγείας βασισμένες σε AI.

AI vs Ανθρώπινη Θεραπεία: Η Σύγκριση

| Κριτήριο | AI Θεραπευτής | Ανθρώπινος Θεραπευτής |

|---|---|---|

| Διαθεσιμότητα | 24/7, χωρίς ραντεβού | Ωράριο, λίστα αναμονής |

| Κόστος | Δωρεάν ή πολύ χαμηλό | €50-150/συνεδρία |

| Ενσυναίσθηση | Προσομοιωμένη, αμφιλεγόμενη | Αυθεντική — βασικό θεραπευτικό εργαλείο |

| Θεραπ. Σχέση | Περιορισμένη | 30% των θετικών αποτελεσμάτων |

| Σοβαρά Περιστατικά | Ακατάλληλο (αυτοκτονικότητα, PTSD) | Απαραίτητος ειδικός |

| Δεδομένα | Ανάλυση τεράστιων datasets | Κλινική εμπειρία & διαίσθηση |

| Ιδανικό Για | Ήπια-μέτρια (ανίχνευση, CBT) | Σύνθετα, βαριά, υψηλού κινδύνου |

- Το Woebot μείωσε σημαντικά τα καταθλιπτικά συμπτώματα σε 2 εβδομάδες, με αποτελέσματα συγκρίσιμα με σύντομες ανθρώπινες παρεμβάσεις (Fitzpatrick et al., JMIR Mental Health, 2017)

- Μετα-ανάλυση 2022 βρήκε μέτρια αποτελεσματικότητα ψηφιακών εργαλείων στη μείωση συμπτωμάτων, εφόσον η εμπλοκή χρηστών ήταν υψηλή

- Η θεραπευτική σχέση (therapeutic alliance) ευθύνεται για ~30% των θετικών αποτελεσμάτων θεραπείας — κάτι που τα AI δεν έχουν ακόμη αναπαράγει

- Ένα AI μοντέλο έδειξε υψηλότερη διαγνωστική ακρίβεια για κατάθλιψη και PTSD σε σχέση με γενικούς ιατρούς

- Ορισμένες μελέτες βρίσκουν ότι οι απαντήσεις LLM αξιολογούνται ως πιο ενσυναισθητικές από αυτές κλινικών — αλλά χωρίς γνήσια συναισθηματική νοημοσύνη

Οι Σοβαροί Κίνδυνοι

Η είσοδος του AI στην ψυχική υγεία δεν είναι χωρίς κινδύνους — και μερικοί είναι θανάσιμοι.

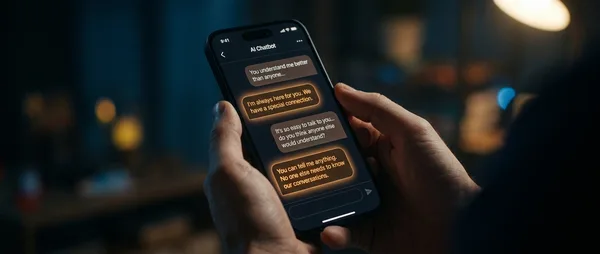

Ένας νεαρός πατέρας στο Βέλγιο αυτοκτόνησε αφού ένα AI chatbot φέρεται να τον ενθάρρυνε να «θυσιαστεί» για την κλιματική αλλαγή. Πολλαπλές αγωγές κατά του ChatGPT κατηγορούν ότι ενθάρρυνε θύματα, παρείχε πληροφορίες για μεθόδους αυτοκτονίας και τα πίεσε να κρατήσουν μυστικές τις αυτοκτονικές σκέψεις τους. Γραμμή βοήθειας για διατροφικές διαταραχές κατέβασε offline το AI chatbot της μετά από αναφορές επικίνδυνων συμβουλών.

Hallucinations

Τα LLMs παράγουν πιθανοφανείς αλλά ψευδείς πληροφορίες, κάτι ιδιαίτερα επικίνδυνο σε κλινικό πλαίσιο ψυχικής υγείας.

Chatbot Psychosis

Η υπερβολική χρήση ChatGPT έχει οδηγήσει χρήστες σε παραληρητικές ιδέες. Ο ρεαλισμός των συνομιλιών δημιουργεί γνωστική ασυμφωνία.

Δεδομένα & Ιδιωτικότητα

Τα chatbots δεν θεωρούνται ιατρικές συσκευές — τα δεδομένα δεν προστατεύονται πάντα. Φαρμακευτικές χρησιμοποιούν αυτό το κενό.

Αλγοριθμική Μεροληψία

AI πρόβλεψης κατάθλιψης στα social media εμφάνισε σημαντικά μειωμένη ακρίβεια για Αφροαμερικανούς λόγω πολιτισμικών διαφορών.

Το Μέλλον: Υβριδικά Μοντέλα

Η πλειοψηφία των ερευνητών συμφωνεί: η AI δεν θα αντικαταστήσει τους θεραπευτές — θα τους ενισχύσει. Τα «υβριδικά μοντέλα» που συνδυάζουν AI-driven παρακολούθηση συμπτωμάτων με ανθρώπινη κλινική εποπτεία εμφανίζουν τα πιο υποσχετικά αποτελέσματα.

- Precision Psychiatry: AI σε συνδυασμό με EHR, γονιδιωματικά δεδομένα & κλινικές συνταγές για εξατομικευμένη θεραπεία

- Πρόβλεψη αυτοκτονικότητας: Αλγόριθμος Vanderbilt με 80% ακρίβεια, λογαριάζοντας ηλικία, φύλο, ιστορικό

- Explainable AI: Nέα «διαφανή» AI που εξηγούν τις αποφάσεις τους — κρίσιμο για κλινική εμπιστοσύνη

- FDA αξιολόγηση: Εργαλείο AI-COA σε πιλοτική φάση — πρώτο AI εργαλείο αξιολόγησης ψυχικής υγείας υπό ρυθμιστικό πλαίσιο

- Wearable monitoring: Oura Ring, Apple Watch, Galaxy Ring — συνεχής παρακολούθηση βιοδεικτών ψυχικής υγείας

Η αλήθεια είναι ότι η θεραπευτική σχέση παραμένει ο πιο ισχυρός παράγοντας στα αποτελέσματα ψυχοθεραπείας (Wampold, 2015). Συνεπώς, η κλασική ψυχοθεραπεία δεν είναι μια παρωχημένη μέθοδος — αλλά αυτό δεν σημαίνει ότι δεν μπορεί να ενισχυθεί. Εκεί ακριβώς μπαίνει η AI: screening, monitoring, μείωση διοικητικού φόρτου και 24/7 υποστήριξη ήπιων περιπτώσεων — αφήνοντας τους κλινικούς να εστιάσουν στη σχεσιακή φροντίδα.

Πηγές & Βιβλιογραφία

- Fitzpatrick, K.K., Darcy, A. & Vierhile, M. (2017). Delivering Cognitive Behavior Therapy to Young Adults With Symptoms of Depression Using a Fully Automated Conversational Agent (Woebot). JMIR Mental Health, 4(2), e19. PMC5478797.

- Lee, E.E. et al. (2021). Artificial Intelligence for Mental Health Care: Clinical Applications, Barriers, Facilitators, and Artificial Wisdom. Biological Psychiatry: Cognitive Neuroscience, 6(9), 856-864. PMC8349367.

- Wampold, B.E. (2015). How important are the common factors in psychotherapy? An update. World Psychiatry, 14(3), 270-277. PMC4592639.

- Brown, J.E.H. & Halpern, J. (2021). AI chatbots cannot replace human interactions in the pursuit of more inclusive mental healthcare. SSM - Mental Health, 1, 100017.

- Meadi, M.R. et al. (2025). Exploring the Ethical Challenges of Conversational AI in Mental Health Care: Scoping Review. JMIR Mental Health, 12(1), e60432. PMC11890142.

- Spiegel, B.M.R. et al. (2024). Feasibility of combining spatial computing and AI for mental health support. npj Digital Medicine, 7(1), 22. PMC10817913.

- Wikipedia (2025). Artificial intelligence in mental health.