📖 Διαβάστε περισσότερα: AR Εφαρμογές: 15 Must-Have Apps 2026

Τι Είναι το Volumetric Video

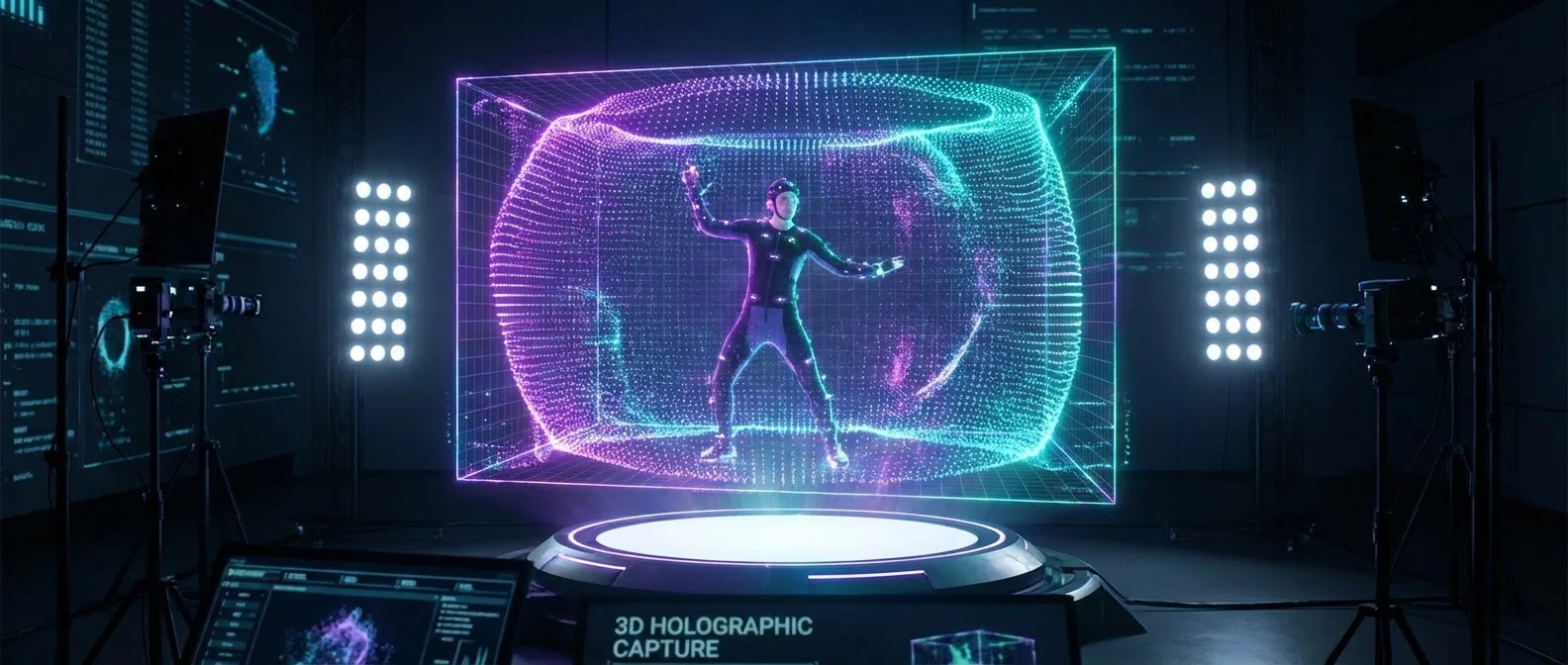

Το volumetric video — ή αλλιώς ογκομετρικό βίντεο — είναι μια τεχνική καταγραφής που αποτυπώνει τρισδιάστατους χώρους, τοποθεσίες ή ερμηνείες ανθρώπων σε πλήρες βάθος. Σε αντίθεση με το κλασικό βίντεο που αποθηκεύει μόνο ένα δισδιάστατο πλαίσιο, το volumetric video αποθηκεύει πληροφορίες θέσης, χρώματος και κίνησης σε τρεις διαστάσεις. Το αποτέλεσμα μπορεί να αναπαραχθεί σε επίπεδες οθόνες, αλλά λάμπει πραγματικά όταν βιώνεται σε VR headsets, όπου ο θεατής μπορεί να περιηγηθεί μέσα στη σκηνή με έξι βαθμούς ελευθερίας (6 DoF).

Η τεχνολογία αυτή συνδυάζει στοιχεία από τα πεδία της φωτογραμμετρίας, των γραφικών υπολογιστή, της σάρωσης LIDAR και της μηχανικής μάθησης. Η ιστορία της ξεκινά από τα πρώτα πειράματα με τρισδιάστατα μοντέλα από βίντεο, αλλά μόνο τα τελευταία χρόνια — χάρη στην άνοδο του VR και σε νέους αλγορίθμους όπως τα Neural Radiance Fields — έγινε πρακτικά εφαρμόσιμη.

Η Ιστορία του Volumetric Capture

Η ιδέα της καταγραφής τρισδιάστατου περιεχομένου χωρίς τους περιορισμούς μιας επίπεδης οθόνης εμπνέει τη φαντασία εδώ και δεκαετίες — από τα ολογράμματα του Star Wars μέχρι τις τεχνολογίες που εξελίχθηκαν σταδιακά στην πραγματικότητα. Το bullet time effect της ταινίας Matrix (1999), με τη χρήση δεκάδων συγχρονισμένων καμερών, αποτέλεσε ένα πρώιμο παράδειγμα πολυ-οπτικής καταγραφής που σήμερα θεωρείται πρόδρομο των volumetric τεχνικών.

Το 2007, οι Radiohead χρησιμοποίησαν σαρωτή LIDAR για το μουσικό βίντεο “House of Cards” — μία από τις πρώτες δημιουργικές χρήσεις volumetric capture. Ο σκηνοθέτης James Frost σε συνεργασία με τον media artist Aaron Koblin κατέγραψαν point cloud παραστάσεις του προσώπου του τραγουδιστή. Τα point clouds, αν και αποτελούν πυκνά δείγματα στον τρισδιάστατο χώρο με θέση και χρώμα, δεν μπορούσαν τότε να αναπαραχθούν σε πραγματικό χρόνο.

Η μεγάλη ώθηση ήρθε το 2010 με την κυκλοφορία του Kinect της Microsoft, μιας καταναλωτικής συσκευής που χρησιμοποιούσε structured light στο υπέρυθρο φάσμα για τη δημιουργία τρισδιάστατου mesh σε πραγματικό χρόνο. Αν και σχεδιασμένο για gameplay, το Kinect υιοθετήθηκε γρήγορα ως γενική συσκευή καταγραφής 3D δεδομένων. Ερευνητές στη Microsoft κατασκεύασαν ένα ολόκληρο capture stage με πολλαπλές κάμερες και αλγορίθμους, που εξελίχθηκε στο Microsoft Mixed Reality Capture Studio — χρησιμοποιήθηκε μεταξύ άλλων στο Blade Runner 2049 VR experience. Σήμερα, τρία studios λειτουργούν: στο Redmond, WA, στο San Francisco, CA και στο Λονδίνο.

Η φωτογραμμετρία (photogrammetry) έφερε ακόμα μεγαλύτερη πιστότητα: χρησιμοποιώντας δεκάδες συγχρονισμένες κάμερες, αλγόριθμοι τριγωνισμού και εκτίμησης βάθους δημιουργούν σχεδόν τέλεια αντίγραφα πραγματικών χώρων. Η 4DViews εγκατέστησε το πρώτο σύστημα volumetric video capture στο Tokyo το 2008, ενώ αργότερα η Intel, η Samsung και φυσικά η Microsoft δημιούργησαν τα δικά τους capture stages.

Ροές Εργασίας: Mesh vs Point Cloud

Υπάρχουν δύο κύριες προσεγγίσεις στη δημιουργία volumetric video, καθεμία με τα δικά της πλεονεκτήματα και περιορισμούς.

Mesh-Based Workflow

Η mesh-based προσέγγιση δημιουργεί παραδοσιακά τρίγωνα mesh, παρόμοια γεωμετρία με αυτή των video games και των visual effects. Ο όγκος δεδομένων είναι μικρότερος, αλλά η κβαντοποίηση (quantization) πραγματικών δεδομένων σε χαμηλότερη ανάλυση περιορίζει τη λεπτομέρεια. Η φωτογραμμετρία χρησιμεύει ως βάση για στατικά meshes, ενώ η capture performance γίνεται μέσω videogrammetry. Το τελικό αποτέλεσμα μοιάζει με pipeline παιχνιδιού: η αναπαραγωγή γίνεται σε real-time engine, επιτρέποντας αλληλεπιδραστικές αλλαγές φωτισμού και compositing στατικών και animated meshes.

Point-Based Workflow

Η point-based προσέγγιση αναπαριστά τα δεδομένα ως σημεία (ή σωματίδια) στον 3D χώρο με χρώμα και μέγεθος. Τα point clouds προσφέρουν υψηλότερη πυκνότητα πληροφοριών και μεγαλύτερη ανάλυση, αλλά απαιτούν τεράστιους ρυθμούς δεδομένων. Ο τρέχων hardware GPU είναι βελτιστοποιημένος για mesh rendering, όχι για points, γεγονός που δυσκολεύει τη real-time απεικόνιση. Ωστόσο, η ποιότητα φωτισμού είναι εξαιρετικά ακριβής — αν και δεν μπορεί να αλλάξει δυναμικά. Ένα σημαντικό πλεονέκτημα: τα γραφικά υπολογιστή μπορούν επίσης να αποδοθούν ως points, ανοίγοντας τη δυνατότητα τέλειας μίξης πραγματικών και φανταστικών στοιχείων.

Neural Radiance Fields: Η Επανάσταση του NeRF

Ίσως η σημαντικότερη ανακάλυψη στο πεδίο τα τελευταία χρόνια είναι τα Neural Radiance Fields (NeRF), που παρουσιάστηκαν για πρώτη φορά το 2020 από ερευνητές του UC Berkeley. Ένα NeRF αναπαριστά μια σκηνή ως μια συνεχή ογκομετρική λειτουργία ακτινοβολίας, παραμετροποιημένη από ένα βαθύ νευρωνικό δίκτυο (deep neural network). Δεδομένης μιας θέσης (x, y, z) και μιας κατεύθυνσης θέασης (θ, φ), το δίκτυο προβλέπει πυκνότητα όγκου και εκπεμπόμενη ακτινοβολία.

Η διαδικασία είναι αξιοσημείωτα απλή στη βάση της: συλλέγονται δεκάδες φωτογραφίες μιας σκηνής από διάφορες γωνίες μαζί με τη θέση της κάμερας. Για κάθε εικόνα, ακτίνες χαράσσονται μέσα στη σκηνή, δημιουργώντας 3D σημεία. Ένα multi-layer perceptron (MLP) εκπαιδεύεται μέσω gradient descent ώστε η εικόνα που παράγει το μοντέλο να ταιριάζει με την πραγματική. Αφού η διαδικασία είναι πλήρως διαφοροποιήσιμη (differentiable), το σφάλμα μπορεί να ελαχιστοποιηθεί αυτόματα.

Το αρχικό NeRF είχε όμως σημαντικούς περιορισμούς: αργή εκπαίδευση (ώρες ή ημέρες), απαίτηση σταθερής φωτισμού στις εικόνες εισόδου, και αδυναμία real-time rendering. Αυτό μας οδήγησε σε ένα κύμα βελτιώσεων που μετέτρεψαν τα NeRF από ερευνητική περιέργεια σε πρακτικό εργαλείο.

Οι Εξελίξεις του NeRF

Από το 2020 και μετά, μια σειρά βελτιώσεων άλλαξαν ριζικά τις δυνατότητες:

- Fourier Feature Mapping (2020): Αντιμετώπισε το πρόβλημα spectral bias, επιτρέποντας πιο γρήγορη σύγκλιση σε υψηλής συχνότητας λεπτομέρειες.

- NeRF in the Wild (2021): Η Google ανέπτυξε μέθοδο που χωρίζει το δίκτυο σε τρία ξεχωριστά MLPs — ένα για στατική ογκομετρική ακτινοβολία, ένα για αλλαγές φωτισμού και ένα για μεταβαλλόμενα αντικείμενα. Αυτό επέτρεψε την εκπαίδευση NeRF από φωτογραφίες κινητών σε διαφορετικές ώρες της ημέρας.

- Mip-NeRF (2021): Βελτίωσε την ευκρίνεια σε πολλαπλές κλίμακες θέασης χρησιμοποιώντας κωνικά frustums αντί μεμονωμένων ακτίνων, εξαλείφοντας σχεδόν τελείως το aliasing.

- PlenOctrees (2021): Επέτρεψε real-time rendering pre-trained NeRF μέσω διαίρεσης σε octree δομές — rendering 3.000× ταχύτερο από το αρχικό NeRF.

- Instant NeRF (2022) — Nvidia: Χρησιμοποιώντας spatial hash functions και παράλληλες αρχιτεκτονικές GPU, επέτρεψε real-time εκπαίδευση NeRF — βελτίωση κατά τάξεις μεγέθους.

- Relighting (2021): Προστέθηκαν νέες παράμετροι στο MLP (normals, materials, visibility), επιτρέποντας re-rendering υπό οποιεσδήποτε συνθήκες φωτισμού χωρίς νέα εκπαίδευση.

3D Gaussian Splatting: Ο Νέος Βασιλιάς

Αν τα NeRF θεωρούνται η “επανάσταση” στο volumetric video, το 3D Gaussian Splatting (3DGS) είναι η “εξέλιξη” που τα ξεπέρασε σε πολλούς τομείς. Παρουσιάστηκε τον Ιούλιο του 2023 από ερευνητές του Inria και πυροδότησε τεράστιο ενδιαφέρον στην κοινότητα γραφικών υπολογιστών.

Αντί να αναπαριστά τη σκηνή ως ογκομετρική συνάρτηση (όπως τα NeRF), το 3DGS χρησιμοποιεί ένα αραιό νέφος τρισδιάστατων Gaussians — κάθε ένα με θέση, συνδιακύμανση (σχήμα ελλειψοειδούς), χρώμα και αδιαφάνεια. Η διαδικασία ξεκινά από ένα αραιό point cloud (μέσω Structure from Motion) και κάθε σημείο μετατρέπεται σε Gaussian. Μέσω stochastic gradient descent, τα Gaussians βελτιστοποιούνται ώστε η εικόνα που “σπλατάρεται” (splatted) στην οθόνη να ταιριάζει με τις εικόνες εκπαίδευσης.

Τα αποτελέσματα είναι εντυπωσιακά: ένα πλήρες μοντέλο 3DGS εκπαιδεύεται σε 35–45 λεπτά (έναντι 48 ωρών για Mip-NeRF360) και αποδίδει σε πραγματικό χρόνο, ενώ το NeRF χρειαζόταν ~10 δευτερόλεπτα ανά frame. Η ποιότητα είναι ισάξια ή ελαφρώς ανώτερη. Η μέθοδος “4D Gaussian Splatting” επεκτείνει τη λογική σε δυναμικές σκηνές, χρησιμοποιώντας χρονική συνιστώσα για κινούμενα αντικείμενα — κρίσιμο για volumetric performance capture ζωντανών ηθοποιών.

NeRF vs 3D Gaussian Splatting: Σύγκριση

Light Fields: Η Επιστήμη του Φωτός

Πέρα από τα NeRF και τα Gaussian Splats, μια τρίτη κατηγορία τεχνολογίας παίζει σημαντικό ρόλο στο volumetric video: τα light fields. Ένα light field περιγράφει, σε κάθε σημείο του χώρου, το εισερχόμενο φως από όλες τις κατευθύνσεις. Η ιδέα ξεκινά από τον Michael Faraday, που πρώτος πρότεινε ότι το φως πρέπει να ερμηνεύεται ως πεδίο, και τυποποιήθηκε από τον Andrey Gershun σε κλασική εργασία του 1936.

Από τεχνολογική άποψη, τα light fields αποτυπώνονται με πολλαπλές κάμερες ή ειδικές συσκευές (plenoptic cameras), ενώ η εταιρεία Lytro — ενεργή από το 2006 — δημιούργησε τις πρώτες καταναλωτικές κάμερες light field. Η Facebook/Meta χρησιμοποίησε παρόμοια ιδέα στην οικογένεια κάμερων Surround360 για λήψη 360° footage με πληροφορίες βάθους. Η δυνατότητα re-focus (εστίαση μετά τη λήψη) και η υποστήριξη ελαφρώς στερεοσκοπικής θέασης καθιστούν τα light fields ιδανικά για immersive content στο VR.

"Η αληθινή εμβύθιση στην εικονική πραγματικότητα δεν θα έρθει από πιο ρεαλιστικά γραφικά — θα έρθει από τη δυνατότητα να κινηθείς ελεύθερα μέσα σε αληθινό τρισδιάστατο περιεχόμενο."

Volumetric Video στο VR και Πέρα

Η ανάπτυξη του consumer VR από το 2016 — με συσκευές όπως το Oculus Rift και το HTC Vive — έδωσε νέα ζωή στο volumetric video. Η στερεοσκοπική θέαση, η δυνατότητα περιστροφής κεφαλής και η μετακίνηση σε μικρό χώρο (room-scale) επιτρέπουν εμβύθιση πέρα από κάθε προηγούμενο μέσο. Η φωτογραφική φύση των captures, σε συνδυασμό με την αλληλεπιδραστικότητα, φέρνουν τους χρήστες πιο κοντά στο “ιερό δισκοπότηρο” της πραγματικής εικονικής πραγματικότητας.

Σήμερα, το volumetric video χρησιμοποιείται ήδη σε εμπορικές εφαρμογές: η εφαρμογή Scenez προσφέρει virtual concerts σε Meta Quest και Apple Vision Pro, ενώ η Apple ανέπτυξε το Apple Immersive Video — πρότυπο για χωρικό βίντεο υψηλής πιστότητας. Η τεχνολογία NeRF χρησιμοποιείται ήδη για δημιουργία immersive content σε εφαρμογές VR, ενώ με τα Gaussian Splats, η real-time απόδοση ανοίγει δρόμους για ζωντανές εμπειρίες — concerts, αθλητικά events, ξεναγήσεις σε μουσεία.

Εκτός VR, οι εφαρμογές πολλαπλασιάζονται: ο αθλητισμός χρησιμοποιεί volumetric replays (η Intel True View σε ποδοσφαιρικά γήπεδα της Arsenal, Liverpool και Manchester City), η ιατρική αξιοποιεί NeRF για ανακατασκευή 3D CT scans από ελάχιστα δείγματα ακτίνων X, η ρομποτική εκμεταλλεύεται τη δυνατότητα κατανόησης διαφανών αντικειμένων, και η αρχιτεκτονική δημιουργεί digital twins κτιρίων πριν καν ξεκινήσει η φυσική κατασκευή.

Προκλήσεις και Μελλοντικές Κατευθύνσεις

Παρά την τρομερή πρόοδο, σημαντικές προκλήσεις παραμένουν. Οι ρυθμοί δεδομένων είναι τεράστιοι: ένα volumetric video πλήρους ανάλυσης μπορεί να παράγει τεραστίους όγκους δεδομένων ανά δευτερόλεπτο. Η MPEG εργάζεται πάνω στη συμπίεση volumetric δεδομένων, αλλά δεν υπάρχει ακόμα ένα καθολικό πρότυπο streaming. Η μνήμη GPU αποτελεί bottleneck — τα Gaussian Splats μπορούν να καταναλώσουν πάνω από 20 GB VRAM κατά τη διάρκεια του training.

Η δημιουργία μιας νέας οπτικής γλώσσας για volumetric εμπειρίες είναι εξίσου κρίσιμη. Σε 100+ χρόνια κινηματογράφου, η τέχνη της σκηνοθεσίας έχει ωριμάσει — αλλά σε ένα πλήρως αλληλεπιδραστικό, 6 DoF κόσμο, οι παραδοσιακές κινηματογραφικές τεχνικές δεν λειτουργούν. Η κοινότητα χρειάζεται χρόνο για να ανακαλύψει τη “γλώσσα” αυτού του νέου μέσου, ακριβώς όπως ο κινηματογράφος χρειάστηκε δεκαετίες μετά την προσθήκη του ήχου.

Επιπλέον, τα υπάρχοντα pipelines παραγωγής βίντεο δεν είναι έτοιμα για volumetric workflows. Κάθε στάδιο — από τη λήψη μέχρι το editing, τον φωτισμό και τη διανομή — πρέπει να επανασχεδιαστεί. Αλλά η πρόοδος είναι ταχύτατη: εργαλεία όπως το Nerfstudio δημοκρατικοποιούν την πρόσβαση, και μεγάλες εταιρείες (Google, Meta, Apple, Nvidia) επενδύουν εκατομμύρια στην ανάπτυξη.

Το Μέλλον: Ψηφιακά Ολογράμματα και Πέρα

Κοιτώντας μπροστά, η συνένωση volumetric capture, generative AI και advanced displays υπόσχεται εμπειρίες που μέχρι πρόσφατα ήταν μόνο science fiction. Η τεχνολογία NeRF έχει ήδη συνδυαστεί με generative AI, επιτρέποντας σε χρήστες χωρίς εμπειρία μοντελοποίησης να αλλάξουν φωτισμό, να αφαιρέσουν αντικείμενα ή να τροποποιήσουν σκηνές μέσω φυσικής γλώσσας. Τα 3D/4D Gaussians ανοίγουν τη δυνατότητα text-to-3D δημιουργίας: πληκτρολογήστε μια περιγραφή και λάβετε ένα πλήρες τρισδιάστατο μοντέλο.

Η εκπαίδευση, η αρχαιολογία, ο τουρισμός και η δημοσιογραφία μπορούν όλα να ωφεληθούν: φανταστείτε εικονικές ξεναγήσεις σε αρχαιολογικούς χώρους, ψηφιακά “μεταφερμένες” εμπειρίες αθλητικών αγώνων, ή immersive ρεπορτάζ από ζώνες σύγκρουσης. Και καθώς οι υπολογιστικές δυνατότητες αυξάνονται, η ζωντανή μετάδοση volumetric video σε VR — σε πραγματικό χρόνο — δεν θα είναι πλέον φαντασία.

Το volumetric video δεν είναι απλά μια τεχνολογική εξέλιξη — είναι η αρχή ενός εντελώς νέου τρόπου αποτύπωσης, αποθήκευσης και βίωσης της πραγματικότητας. Και στην εποχή του VR, βρίσκεται στο επίκεντρο αυτής της αλλαγής.

Βασικά Σημεία

- Το volumetric video καταγράφει τρισδιάστατα δεδομένα με πλήρες βάθος για VR εμπειρίες 6 DoF

- Η Microsoft Mixed Reality Capture Studios λειτουργεί σε 3 τοποθεσίες παγκοσμίως

- Τα NeRF (2020) επέτρεψαν ανακατασκευή 3D σκηνών από απλές φωτογραφίες

- Τα PlenOctrees προσφέρουν 3.000× ταχύτερο rendering σε σχέση με το αρχικό NeRF

- Το 3D Gaussian Splatting εκπαιδεύεται σε 35-45 λεπτά αντί 48 ωρών

- Η Apple, η Meta και η Intel επενδύουν σε εμπορικές εφαρμογές volumetric video

- Τα light fields επιτρέπουν re-focus μετά τη λήψη και στερεοσκοπική θέαση

- Οι κυριότερες προκλήσεις: data rates, VRAM >20 GB, έλλειψη streaming standard

- Generative AI + NeRF/3DGS ανοίγει τον δρόμο για text-to-3D δημιουργία