📖 Διαβάστε περισσότερα: Eye Tracking VR: Πώς Αλλάζει την Εμπειρία

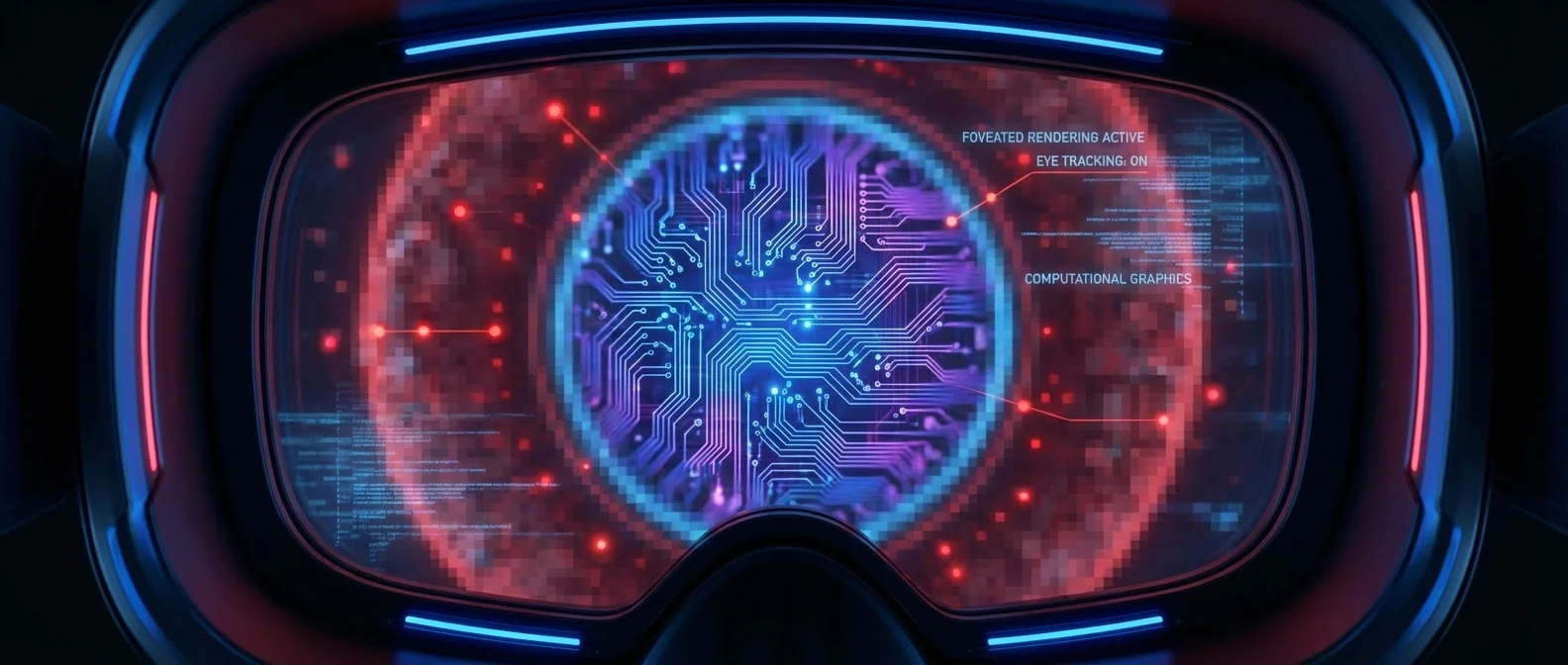

👁️ Τι Είναι το Foveated Rendering

Το foveated rendering είναι μια τεχνική απόδοσης γραφικών που μιμείται τον τρόπο λειτουργίας του ανθρώπινου ματιού. Αντί να αποδίδει κάθε pixel της οθόνης σε πλήρη ανάλυση, η τεχνική αυτή εντοπίζει πού ακριβώς κοιτά ο χρήστης και αποδίδει σε υψηλή ποιότητα μόνο εκείνη τη μικρή περιοχή — συνήθως 2-5 μοίρες γύρω από το σημείο εστίασης. Η υπόλοιπη εικόνα αποδίδεται σε χαμηλότερη ανάλυση, κάτι που ο χρήστης πρακτικά δεν αντιλαμβάνεται λόγω της φυσικής λειτουργίας της περιφερειακής όρασης.

Η ονομασία προέρχεται από τη fovea centralis, ένα μικροσκοπικό βαθούλωμα στο κέντρο του αμφιβληστροειδούς, μεγέθους μόλις 1,5 mm, που είναι αποκλειστικά υπεύθυνο για την οξεία κεντρική όρασή μας. Σύμφωνα με τη Wikipedia, η fovea περιέχει αποκλειστικά κωνία (cone cells) πυκνά συμπιεσμένα — περίπου 147.000 ανά τετραγωνικό χιλιοστό — και αν και καταλαμβάνει λιγότερο από 1% της επιφάνειας του αμφιβληστροειδούς, καταναλώνει πάνω από 50% του οπτικού φλοιού του εγκεφάλου. Με άλλα λόγια, ο εγκέφαλός μας αφιερώνει τεράστιους πόρους σε ένα ελάχιστο τμήμα του οπτικού πεδίου — και τα VR headsets πρέπει να κάνουν ακριβώς το αντίθετο: να μην σπαταλούν πόρους εκεί που δεν χρειάζεται.

Η τεχνική αυτή υπάρχει σε δύο κύριες μορφές. Η πρώτη είναι το fixed foveated rendering (σταθερό), που δεν χρησιμοποιεί eye tracking αλλά υποθέτει ότι ο χρήστης κοιτά πάντα περίπου στο κέντρο του φακού — μια λογική υπόθεση σε πολλά σενάρια. Η δεύτερη, πιο εξελιγμένη μορφή, είναι το dynamic foveated rendering (δυναμικό), που ενσωματώνει αισθητήρες eye tracking για να παρακολουθεί σε πραγματικό χρόνο πού ακριβώς κοιτά ο χρήστης και να προσαρμόζει αντίστοιχα τη ζώνη υψηλής ανάλυσης.

🧠 Πώς Λειτουργεί

Η βασική αρχή είναι απλή: δημιουργούνται τρεις ομόκεντρες ζώνες ποιότητας γύρω από το σημείο εστίασης. Η εσωτερική ζώνη (foveal region) αποδίδεται σε πλήρη ανάλυση — αυτή αντιστοιχεί στην οξύτερη περιοχή της fovea, περίπου 2 μοίρες οπτικού πεδίου ή, για να το κάνουμε πιο παραστατικό, περίπου στο μέγεθος δύο αντίχειρων σε απόσταση βραχίονα. Η μέση ζώνη (parafoveal) αποδίδεται σε μέτρια ανάλυση — εδώ η ανθρώπινη ικανότητα διάκρισης λεπτομέρειας μειώνεται σημαντικά. Τέλος, η εξωτερική ζώνη (peripheral) αποδίδεται στη χαμηλότερη ανάλυση — η περιφερειακή μας όραση αντιλαμβάνεται κυρίως κίνηση και αδρά σχήματα, όχι λεπτομέρεια.

Σε ένα σύστημα δυναμικού foveated rendering, αισθητήρες υπερύθρων (infrared LEDs) ενσωματωμένοι στο εσωτερικό του headset εκπέμπουν αόρατο φως προς τα μάτια. Κάμερες υψηλής ταχύτητας — τυπικά 120-250 Hz — καταγράφουν την αντανάκλαση στην κόρη και τον κερατοειδή χιτώνα. Αλγόριθμοι υπολογίζουν σε πραγματικό χρόνο τη θέση του βλέμματος (gaze vector) και μεταδίδουν αυτή την πληροφορία στη μηχανή γραφικών, η οποία αναδιαμορφώνει τις ζώνες ποιότητας frame-by-frame. Η συνολική καθυστέρηση (eye-to-photon latency) είναι κρίσιμη: αν υπερβεί τα 50-70 ms, ο χρήστης αρχίζει να αντιλαμβάνεται θόλωση στο περιφερειακό πεδίο κατά τις γρήγορες κινήσεις ματιών (saccades).

Η NVIDIA παρουσίασε στο SIGGRAPH 2016 μια μέθοδο foveated rendering που ισχυρίστηκε ότι ήταν «αόρατη» στους χρήστες — δηλαδή η μετάβαση ανάμεσα στις ζώνες ποιότητας γινόταν τόσο ομαλά ώστε κανείς δεν μπορούσε να τη διακρίνει. Η τεχνική βασίστηκε σε συνεργασία με την SMI (SensoMotoric Instruments), η οποία στο CES 2016 είχε ήδη παρουσιάσει νέο σύστημα eye tracking 250 Hz για VR headsets. Η Qualcomm, από την πλευρά της, ενσωμάτωσε το 2017 υποστήριξη foveated rendering (Adreno Foveation) στο Snapdragon 835 VRDK, φέρνοντας τη δυνατότητα αυτή σε mobile VR chipsets.

«Η fovea centralis βλέπει μόνο τις κεντρικές 2 μοίρες του οπτικού πεδίου, αλλά καταναλώνει πάνω από 50% του οπτικού φλοιού. Μισές νευρικές ίνες του οπτικού νεύρου μεταφέρουν πληροφορίες αποκλειστικά από τη fovea.»

🔬 Η Βιολογία Πίσω από την Τεχνολογία

Για να κατανοήσετε γιατί το foveated rendering είναι τόσο αποτελεσματικό, χρειάζεται μια σύντομη βουτιά στη βιολογία της όρασης. Ο ανθρώπινος αμφιβληστροειδής χωρίζεται σε τρεις κύριες ζώνες: τη fovea (διάμετρος ~1,5 mm), την parafovea (εκτείνεται σε ακτίνα 1,25 mm γύρω από τη fovea) και την perifovea (ακτίνα 2,75 mm). Πέρα από αυτές, εκτείνεται η ευρύτερη περιφερειακή περιοχή.

Η fovea περιέχει 50 κωνία ανά 100 μm — εξαιρετικά πυκνά πακεταρισμένα σε εξαγωνικό μοτίβο. Η parafovea διαθέτει ακόμη υψηλή πυκνότητα κωνίων αλλά ήδη χαμηλότερη οξύτητα, ενώ η perifovea πέφτει στα 12 κωνία ανά 100 μm. Η πρακτική συνέπεια είναι εντυπωσιακή: η ικανότητά μας να διακρίνουμε λεπτομέρειες μειώνεται δραστικά μόλις λίγες μοίρες μακριά από το σημείο εστίασης. Κάθε κωνίο στο κέντρο της fovea συνδέεται σχεδόν 1-προς-1 με ένα γαγγλιακό κύτταρο, δημιουργώντας έναν αναλογία κυττάρων-γαγγλίων προς φωτοϋποδοχείς περίπου 2,5:1 — κάτι μοναδικό στη βιολογία, που εγγυάται εξαιρετική χωρική ανάλυση.

Αξίζει να σημειωθεί ότι η fovea δεν περιέχει ραβδία (rod cells), καθιστώντας την μη ευαίσθητη σε χαμηλό φωτισμό — γι' αυτό οι αστρονόμοι χρησιμοποιούν «averted vision», κοιτώντας πλάγια για να δουν αμυδρά αστέρια. Αυτή η βιολογική ιδιαιτερότητα σημαίνει ότι σε ένα VR περιβάλλον, η ανάγκη για pixel-perfect απόδοση περιορίζεται πραγματικά σε ένα πολύ μικρό τμήμα. Σύμφωνα με υπολογισμούς βασισμένους στη μέση πυκνότητα κωνίων, το ανθρώπινο μάτι χρειάζεται περίπου 655 PPI σε απόσταση 25 cm (τηλέφωνο) και 96 PPI σε απόσταση 1,73 m (τηλεόραση) για να μην διακρίνει μεμονωμένα pixels — αλλά αυτές οι τιμές ισχύουν μόνο για τη fovea. Η περιφέρεια αρκείται σε πολύ λιγότερα.

📖 Διαβάστε περισσότερα: Meta Quest 4: Τι Γνωρίζουμε για τη Νέα Γενιά

🎮 Headsets που Χρησιμοποιούν Foveated Rendering

Η τεχνολογία δεν είναι πλέον πειραματική — βρίσκεται ήδη σε consumer headsets. Ας δούμε τα σημαντικότερα:

Το HTC Vive Pro Eye (2019) ήταν ένα από τα πρώτα headsets με ενσωματωμένο eye tracking για foveated rendering. Η Tobii παρείχε τους αισθητήρες eye tracking 120 Hz. Το Meta Quest Pro (2022) ακολούθησε με δυναμικό foveated rendering χάρη σε infrared αισθητήρες eye tracking, βελτιώνοντας αισθητά την καθαρότητα εικόνας χωρίς να αυξάνει τις GPU απαιτήσεις. Το PlayStation VR2 (2023) ενσωμάτωσε τη Tobii eye tracking τεχνολογία απευθείας στην κονσόλα gaming, κάνοντας το foveated rendering προσιτό σε εκατομμύρια παίκτες PS5.

Το Apple Vision Pro (2024) πήγε ένα βήμα παραπέρα: ολόκληρη η διεπαφή χρήστη του visionOS βασίζεται στο eye tracking — κοιτάτε ένα στοιχείο για να το επιλέξετε, και το foveated rendering τρέχει συνεχώς στο παρασκήνιο. Η πιο πρόσφατη εξέλιξη ήρθε τον Νοέμβριο 2025 με την ανακοίνωση του Valve Steam Frame, που εισάγει μια παραλλαγή ονομαζόμενη «foveated streaming» — χρησιμοποιεί eye tracking για να μεταβάλλει δυναμικά το bitrate σε wireless streaming, αποδίδοντας υψηλό bitrate στο κέντρο του βλέμματος και χαμηλότερο στην περιφέρεια σε επίπεδο encoder, ΟΧΙ σε επίπεδο λογισμικού.

Ακόμα και χωρίς eye tracking, το fixed foveated rendering αποδίδει σημαντικά. Τον Δεκέμβριο 2019, η Oculus πρόσθεσε υποστήριξη δυναμικού fixed foveated rendering στο αρχικό Quest SDK, βελτιώνοντας την απόδοση σε standalone mobile VR. Η τεχνική αυτή απλώς αποδίδει χαμηλότερη ανάλυση στις γωνίες του φακού, χωρίς να γνωρίζει πού κοιτά ο χρήστης — αλλά λειτουργεί αρκετά καλά γιατί οι φακοί VR headsets παρουσιάζουν ούτως ή άλλως χαμηλότερη οπτική ποιότητα στην περιφέρεια.

Headsets με Foveated Rendering

⚡ Πόσο GPU Εξοικονομεί

Τα αριθμητικά στοιχεία είναι εντυπωσιακά. Σύμφωνα με τον Michael Abrash, chief scientist της Oculus/Meta, ο συνδυασμός foveated rendering με sparse rendering και deep learning image reconstruction μπορεί να μειώσει κατά μία τάξη μεγέθους (10x) τον αριθμό pixels που χρειάζεται να αποδοθούν σε σύγκριση με μια πλήρη εικόνα. Αυτό σημαίνει ότι ένα headset θεωρητικά θα μπορούσε να τρέξει γραφικά 8K-per-eye ποιότητας με GPU resources αντίστοιχα ενός 4K rendering.

Πρακτικά, τα σημερινά συστήματα δυναμικού foveated rendering εξοικονομούν 30-50% GPU workload, με τα καλύτερα implementations να φτάνουν 60%. Η εξοικονόμηση δεν είναι μόνο σε GPU cycles: λιγότερα rendered pixels σημαίνει λιγότερη κατανάλωση μπαταρίας (κρίσιμο για standalone headsets), χαμηλότερη θερμοκρασία λειτουργίας, και δυνατότητα χρήσης ελαφρύτερων, αποδοτικότερων chips. Η Meta αποδέδειξε αυτά τα αποτελέσματα μέσω του έργου DeepFovea, που χρησιμοποιεί generative adversarial networks (GANs) για να αναπαράγει πλήρη ποιότητα εικόνας από ελάχιστα rendered pixels στην περιφέρεια.

Υπάρχει βέβαια και η αινιγματική ερώτηση: αν εξοικονομούμε 50% GPU, τι γίνεται αυτό το «κέρδος»; Στην πράξη, οι developers μπορούν να το επανεπενδύσουν σε υψηλότερη ανάλυση στη foveal ζώνη, πιο σύνθετα shaders, ρεαλιστικότερο φωτισμό (ray tracing), ή υψηλότερο frame rate — παράγοντες που βελτιώνουν τόσο την οπτική ποιότητα όσο και τη μείωση motion sickness.

🔮 Μέλλον: AI, Retinal και Νέα Headsets

Η τεχνολογία foveated rendering εξελίσσεται ραγδαία, και το 2026 βρισκόμαστε σε ένα σημείο καμπής. Η τεχνητή νοημοσύνη παίζει ολοένα μεγαλύτερο ρόλο: το DeepFovea της Meta χρησιμοποιεί deep learning για να «φανταστεί» τι θα έπρεπε να εμφανίζεται στην περιφέρεια βάσει ελάχιστης πληροφορίας, δημιουργώντας μια εικόνα που μοιάζει πλήρως rendered αλλά κοστίζει ένα κλάσμα του υπολογιστικού φόρτου. Αυτή η προσέγγιση — gaze-contingent rendering ενισχυμένο με AI — θεωρείται ο πυλώνας για τα headsets επόμενης γενιάς.

Η έρευνα στον τομέα ξεκίνησε ήδη από το 1991, αλλά μόνο τώρα — με αισθητήρες eye tracking αρκετά γρήγορους και ακριβείς, GPUs αρκετά ισχυρές για σύνθετο variable rate shading, και AI μοντέλα αρκετά «έξυπνα» για image reconstruction — βρίσκουμε τη σύγκλιση τεχνολογιών που κάνει τη μεγάλη διαφορά. Η Valve μόλις το απέδειξε με το Steam Frame: η τεχνική μπορεί να εφαρμοστεί ακόμα και στο video encoding, μεταφέροντας τη λογική «render λιγότερα εκεί που δεν κοιτάς» πέρα από τον renderer στο networking layer.

Κοιτώντας μπροστά, η τάση είναι ξεκάθαρη: κάθε σημαντικό VR headset του 2026-2027 θα ενσωματώνει eye tracking ως βασική λειτουργία. Η εξέλιξη αυτή δεν αφορά μόνο rendering — το eye tracking ξεκλειδώνει επίσης φυσικότερες αλληλεπιδράσεις UI, καλύτερο social presence μέσω αναπαράστασης βλέμματος σε avatars, και νέες δυνατότητες accessibility. Το foveated rendering είναι η πρώτη, και πιθανόν πιο σημαντική, εφαρμογή αυτής της τεχνολογίας — αλλά σίγουρα δεν θα είναι η τελευταία.

Βασικά Συμπεράσματα

- Η fovea centralis βλέπει μόνο 2° αλλά χρησιμοποιεί 50%+ του οπτικού φλοιού

- Fixed foveated rendering λειτουργεί χωρίς eye tracking — υποθέτει κέντρο φακού

- Dynamic foveated rendering χρησιμοποιεί infrared eye tracking 120-250 Hz

- Εξοικονόμηση GPU 30-60%, θεωρητικά έως 10x με AI reconstruction

- PSVR2, Quest Pro, Apple Vision Pro, Steam Frame: ήδη στην αγορά

- Το DeepFovea της Meta χρησιμοποιεί GANs για αναπαράσταση περιφέρειας

- Το foveated streaming (Valve) εφαρμόζει την αρχή στο video encoding layer