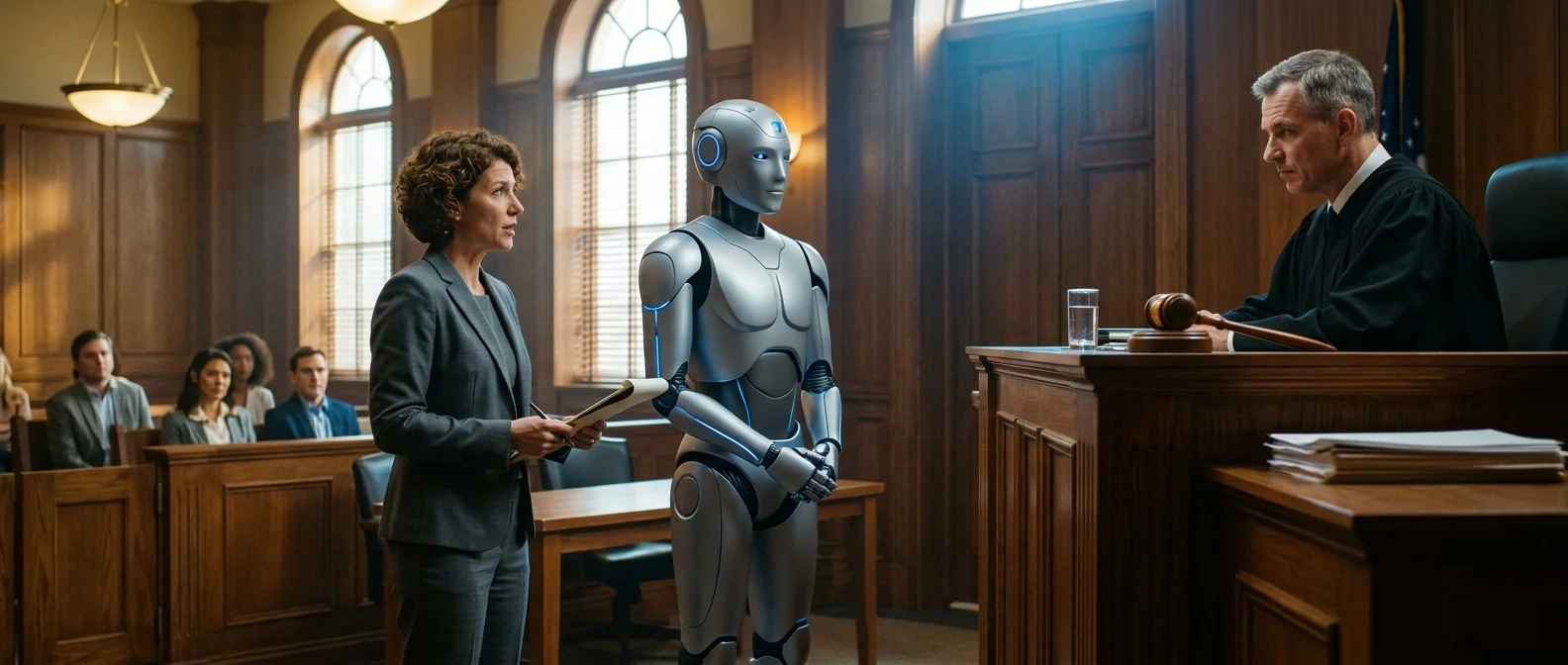

⚖️ Ο EU AI Act: Ο Πρώτος Νόμος AI στον Κόσμο

Τον Αύγουστο του 2024, η Ευρωπαϊκή Ένωση έθεσε σε ισχύ τον EU AI Act (Κανονισμός EU 2024/1689) — το πρώτο ολοκληρωμένο νομικό πλαίσιο για την AI παγκοσμίως. Ο Κανονισμός βασίζεται σε μια προσέγγιση 4 επιπέδων κινδύνου — από τον μηδενικό μέχρι τον απαράδεκτο. Ο στόχος είναι ξεκάθαρος: τα AI συστήματα πρέπει να είναι αξιόπιστα, ασφαλή και σεβαστικά των θεμελιωδών δικαιωμάτων.

📖 Διαβάστε ακόμα: Ρομπότ Οικιακών: Καθαρίζουν, Μαγειρεύουν, Τα Κάνουν Όλα

📖 Διαβάστε ακόμα: Sandbox Πόλεις: Ζώνες Δοκιμών Τεχνολογίας

🚫 Τι Απαγορεύει ο EU AI Act

Από τον Φεβρουάριο 2025, οκτώ πρακτικές AI είναι πλέον παράνομες στην ΕΕ:

- Κοινωνική βαθμολόγηση (social scoring) — το κινεζικό μοντέλο αξιολόγησης πολιτών είναι αδιανόητο στην Ευρώπη

- Αναγνώριση συναισθημάτων σε χώρους εργασίας και εκπαίδευσης

- Βιομετρική κατηγοριοποίηση βάσει προστατευόμενων χαρακτηριστικών (φυλή, θρησκεία, σεξουαλικός προσανατολισμός)

- Ανεξέλεγκτη συλλογή προσώπων από το internet ή CCTV για βάσεις αναγνώρισης προσώπου

- Πρόβλεψη εγκληματικότητας ατόμων βάσει αλγορίθμων

- Απατηλή χειραγώγηση μέσω AI που εκμεταλλεύεται ευάλωτες ομάδες

Για τα AI υψηλού κινδύνου — όπως αυτά που χρησιμοποιούνται σε προσλήψεις, πιστοληπτική αξιολόγηση, δικαιοσύνη και κρίσιμες υποδομές — ο Κανονισμός επιβάλλει αυστηρές υποχρεώσεις: αξιολόγηση κινδύνου, datasets υψηλής ποιότητας, ανθρώπινη επίβλεψη, ιχνηλασιμότητα και κυβερνοασφάλεια. Οι κανόνες θεσπίζονται τον Αύγουστο 2026-2027.

📋 Ευθύνη Αλγορίθμων: Ποιος Πληρώνει;

Πέρα από τον AI Act, η Ευρωπαϊκή Επιτροπή πρότεινε τον Σεπτέμβριο 2022 την AI Liability Directive (AILD) — μια Οδηγία που στοχεύει στην προσαρμογή των κανόνων αστικής ευθύνης στην εποχή του AI. Το κεντρικό πρόβλημα; Όταν ένα AI προκαλεί ζημία, το θύμα δυσκολεύεται να αποδείξει ποιος φταίει — γιατί οι αλγόριθμοι είναι συχνά «μαύρα κουτιά».

Η Ευρωπαϊκή Επιτροπή αναγνώρισε ότι οι υπάρχοντες νόμοι είναι ανεπαρκείς για τις προκλήσεις που θέτει η AI. Η AILD στοχεύει να διευκολύνει την απόδειξη ζημίας για τους πολίτες, εξασφαλίζοντας ότι όσοι ζημιώνονται από AI συστήματα θα έχουν το ίδιο επίπεδο προστασίας με όσους ζημιώνονται από άλλες τεχνολογίες.

Στην πράξη, αυτό σημαίνει: αν ένα AI σύστημα σας αρνηθεί δάνειο, σας απορρίψει σε πρόσληψη, ή προκαλέσει υλική ζημία, δεν χρειάζεται να αποδείξετε πώς λειτουργεί εσωτερικά ο αλγόριθμος. Το βάρος της απόδειξης μεταφέρεται στον πάροχο του AI.

📖 Διαβάστε ακόμα: Συντροφιά με AI: Σχέσεις Ανθρώπου-Ρομπότ 2035

🤖 Ηλεκτρονικό Πρόσωπο: Δικαιώματα για Ρομπότ;

Το 2017, το Ευρωπαϊκό Κοινοβούλιο ψήφισε ψήφισμα που πρότεινε τη δημιουργία «ηλεκτρονικού προσώπου» (electronic personhood) για τα πιο εξελιγμένα ρομπότ. Η ιδέα προκάλεσε έντονη αντίδραση: πάνω από 150 εμπειρογνώμονες υπέγραψαν ανοιχτή επιστολή κατά της πρότασης, υποστηρίζοντας ότι θα υπονόμευε την ευθύνη των κατασκευαστών.

Το ερώτημα παραμένει ανοιχτό: αν ένα AI σύστημα μπορεί να παίρνει αυτόνομες αποφάσεις που επηρεάζουν ζωές, πρέπει να έχει κάποια μορφή νομικής υπόστασης; Η πλειοψηφία των νομικών και ηθικολόγων απαντά όχι — τουλάχιστον όχι ακόμα. Η ευθύνη πρέπει να παραμένει στους ανθρώπους που σχεδιάζουν, αναπτύσσουν και χρησιμοποιούν τα AI συστήματα.

📖 Διαβάστε ακόμα: Το Σπίτι του 2050: AI, Ολογράμματα & Ρομπότ που Αλλάζουν τη

🌍 Ποιος Ελέγχει την AI Παγκοσμίως;

Η ΕΕ δεν είναι μόνη. Η επιτήρηση του AI Act ασκείται από τρεις φορείς: το European AI Board (εκπρόσωποι κρατών-μελών), το Scientific Panel (ανεξάρτητοι εμπειρογνώμονες) και το Advisory Forum (ενδιαφερόμενα μέρη). Το AI Office της Ευρωπαϊκής Επιτροπής εποπτεύει την εφαρμογή και ελέγχει τα πιο ισχυρά μοντέλα γενικού σκοπού (GPAI), όπως τα GPT και Gemini.

Σε εθνικό επίπεδο, κάθε κράτος-μέλος όρισε αρχές εποπτείας αγοράς (market surveillance authorities) για την τήρηση των κανόνων. Επιπλέον, οι αρχές προστασίας θεμελιωδών δικαιωμάτων αποκτούν ειδικές εξουσίες για να ζητούν πληροφορίες και συνεργασία από παρόχους AI σε περιπτώσεις σοβαρών περιστατικών.

🔮 Τι Ακολουθεί

Τον Αύγουστο 2026, οι κανόνες για τα AI υψηλού κινδύνου και οι υποχρεώσεις διαφάνειας θα τεθούν σε εφαρμογή. Αυτό σημαίνει ότι κάθε chatbot θα πρέπει να δηλώνει ότι είναι μηχανή, τα deepfakes θα πρέπει να σημαίνονται, και οι πάροχοι generative AI θα πρέπει να εξασφαλίζουν ότι το περιεχόμενό τους είναι αναγνωρίσιμο ως AI-generated.

Το πραγματικό ερώτημα δεν είναι αν τα ρομπότ χρειάζονται δικαιώματα — αλλά αν εμείς έχουμε δικαιώματα απέναντί τους. Δικαίωμα να ξέρουμε πότε μιλάμε με μηχανή. Δικαίωμα να προσβάλουμε μια απόφαση αλγορίθμου. Δικαίωμα να μην παρακολουθούμαστε, να μην βαθμολογούμαστε, να μην διακρινόμαστε. Και αυτά τα δικαιώματα, για πρώτη φορά, έχουν πλέον νομική βάση.