⚡ Πραγματικός Χρόνος Κώδικα με 1000+ Tokens Ταχύτητα

📖 Διαβάστε ακόμα: GPT-5.3-Codex: AI που Δημιουργεί το Ίδιο του τον Κώδικα

🔬 Το AI που Αντιδρά Πιο Γρήγορα από το Πληκτρολόγιό σου

Το GPT-5.3-Codex-Spark δεν είναι upgrade — είναι trade-off. Θυσιάζει βάθος για ταχύτητα, και το κάνει χωρίς ντροπή. Όπου το κανονικό Codex χρειάζεται 3-6 δευτερόλεπτα για μία συνάρτηση 30 γραμμών, το Spark την τελειώνει σε λιγότερο από μισό δευτερόλεπτο. Μισό δευτερόλεπτο. Γρηγορότερα από όσο μπορεί η οθόνη σου να δείξει τη διαφορά ανάμεσα στο "περιμένω" και το "έτοιμο".Τα Νούμερα πίσω από την Ταχύτητα

Σύμφωνα με τις μετρήσεις του ZDNet, το Codex Spark παρέχει περίπου 15x το throughput του κλασικού GPT-5.3-Codex. Αλλά τι σημαίνει αυτό στην πράξη;📖 Διαβάστε ακόμα: Marble World Labs: 3D Κόσμοι από Κείμενο Fei-Fei Li

💻 Cerebras: Το Silicon που Κάνει τη Διαφορά

Η ταχύτητα προέρχεται από το hardware. Το Cerebras Wafer Scale Engine 3 είναι κάτι που δεν έχει ξανάδει η βιομηχανία AI inference — ένα single silicon wafer με 4 τρισεκατομμύρια transistors σε chip περίπου 46,225 τετραγωνικά χιλιοστά. Για σύγκριση; Ένα NVIDIA H100 GPU έχει περίπου 80 δισεκατομμύρια transistors σε 814 τετραγωνικά χιλιοστά. Το WSE-3 είναι κυριολεκτικά 50x μεγαλύτερη επιφάνεια silicon.Γιατί το Μέγεθος Μετράει

Το μεγαλύτερο bottleneck στο transformer inference δεν είναι η επεξεργαστική ισχύς — είναι το memory bandwidth. Το πήγαινε-έλα δεδομένων ανάμεσα σε chips, memory layers, processing units. Το WSE-3 εξαλείφει τα περισσότερα από αυτά κρατώντας ολόκληρο το μοντέλο και τη working memory του σε ένα κομμάτι silicon. Χωρίς καθυστερήσεις inter-chip communication. Χωρίς PCIe bottlenecks. Τα δεδομένα είναι ήδη εκεί που χρειάζονται.📊 Benchmarks: Πού Βρίσκεται το Spark στη Σύγκριση

Τα νούμερα είναι σκληρά. Το Codex Spark ανταλλάσσει ικανότητα με ταχύτητα, και δεν το κρύβει. | Μοντέλο | Ταχύτητα | SWE-bench Score | Καλύτερο Για | |---------|----------|-----------------|---------------| | **GPT-5.3-Codex-Spark** | 1000+ tok/s | ~58% | Γρήγορα edits, prototyping | | GPT-5.3-Codex | ~65 tok/s | ~72% | Σύνθετα agentic tasks | | Cursor Composer 2 | ~80-120 tok/s | ~65% | Full IDE integration | | Claude Code (Sonnet 4) | ~90 tok/s | ~70% | Deep code reasoning | Το ~58% SWE-bench score έναντι του ~72% του κανονικού Codex σημαίνει ότι το Spark θα παλέψει με σύνθετα, multi-step debugging tasks που χρειάζονται βαθιά κατανόηση του codebase. Αλλά για το 80% της καθημερινής δουλειάς — μικρά edits, νέες συναρτήσεις, refactors, test writing — η ταχύτητα κάνει τη διαφορά.📖 Διαβάστε ακόμα: GPT-5.4 Mini και Nano: 2x Ταχύτερα Μοντέλα OpenAI

🎯 Πού το Spark Λάμπει (και Πού Αδυνατεί)

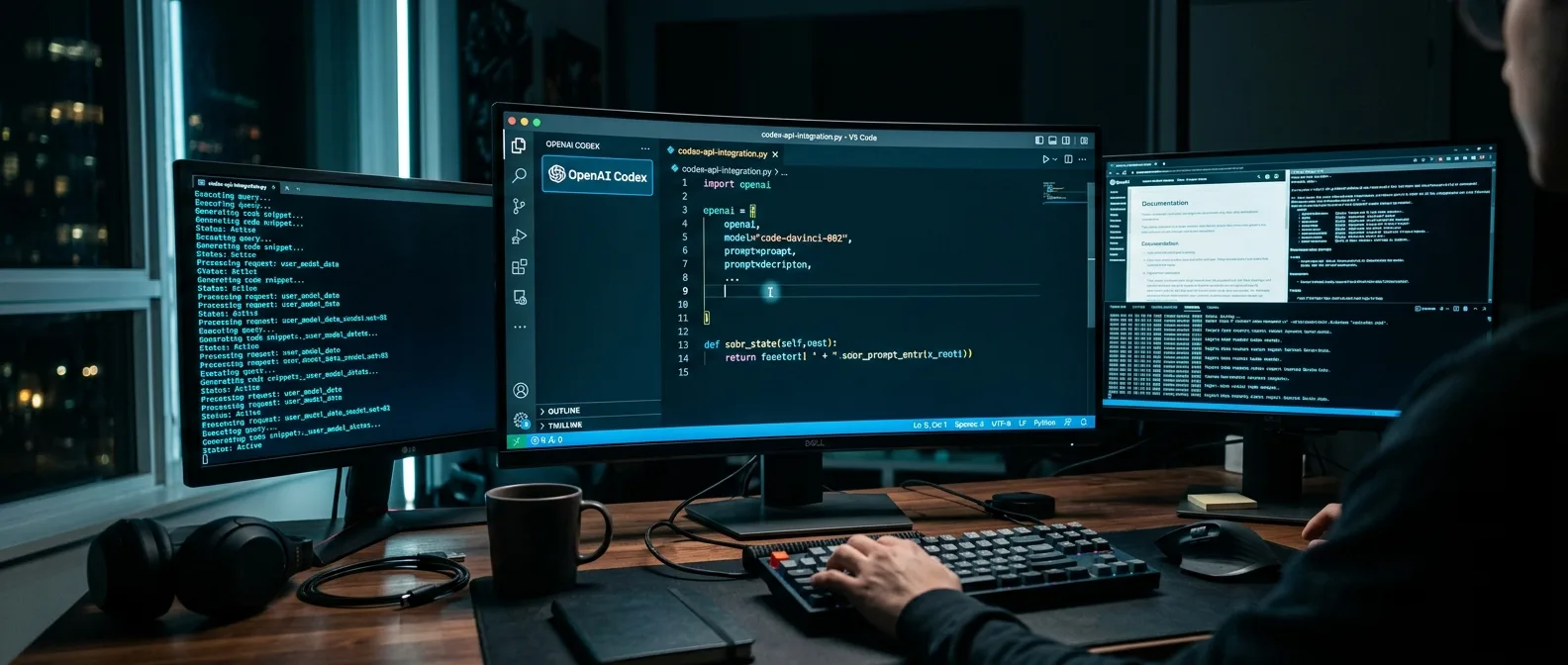

Πραγματικός Χρόνος Code Collaboration

Στα 1000+ tokens per second, το Codex Spark αντιδρά αρκετά γρήγορα ώστε να νιώθεις σαν να έχεις έναν human pair programmer να γράφει δίπλα σου — εκτός από το ότι αυτός ο "άνθρωπος" δεν σταματάει ποτέ να σκεφτεί, δεν ξεχνάει function signatures, και δεν σε ρωτάει να επαναλάβεις. Στο VS Code extension, τα edits εμφανίζονται inline σχεδόν με την ταχύτητα που μπορείς να τα διαβάσεις. Η εμπειρία είναι ποιοτικά διαφορετική από αργά μοντέλα.Rapid Prototyping και "Vibe Coding"

Αν έχεις κάνει ποτέ "vibe coding" — δηλαδή να iterάρεις σε μία ιδέα παράγοντας, τροποποιώντας και regenerating κώδικα μέχρι να αισθάνεται σωστός — το Spark είναι φτιαγμένο ακριβώς γι' αυτό το workflow. Ο sub-second response time σημαίνει ότι μπορείς να δοκιμάσεις δέκα παραλλαγές στον χρόνο που θα χρειαζόσουν για δύο απαντήσεις από κανονικό μοντέλο.Οι Αδυναμίες

Αλλά ας είμαστε ειλικρινείς. Ρώτησε το Spark να refactor ολόκληρο module με πολλά αλληλεξαρτώμενα αρχεία, και θα παρατηρήσεις ότι παίρνει αποφάσεις που ένα πιο προσεκτικό μοντέλο δεν θα έκανε. Η ταχύτητα έρχεται σε βάρος του "thinking time".Το Spark δεν είναι προσεκτικός code architect. Είναι ένας high-speed brainstorming partner.

— Computer Tech Review, 2026

📖 Διαβάστε ακόμα: GPT-5.4: Πόσο Ταχύτερο και Ικανό είναι το Νέο AI Model;

💰 Πρόσβαση και Κόστος: Τι Πληρώνεις

Το GPT-5.3-Codex-Spark είναι διαθέσιμο αυστηρά μέσω ChatGPT Pro subscription — περίπου €180 το μήνα στην Ευρώπη. Είναι ακριβό, και δεν υπάρχει τρόπος να το αποφύγεις. Αλλά έχει nuance: το ChatGPT Pro δεν είναι μόνο Codex Spark. Παίρνεις επίσης απεριόριστη πρόσβαση σε GPT-5.3, GPT-5.4, κανονικό Codex, και κάθε άλλο μοντέλο στη lineup της OpenAI.Εναλλακτικές

Για σύγκριση, το Cursor Pro κοστίζει €18 το μήνα. Το Claude Code CLI είναι δωρεάν (πληρώνεις API costs). Μπορείς να αποκτήσεις πολύ ικανό coding AI για κλάσμα της τιμής.📖 Διαβάστε ακόμα: OpenAI O1: Το AI που Σκέφτεται Όπως οι Άνθρωποι